ComfyUI: KI-Bilderzeugung meistern

Die Ausführung von SDXL mit hohen Auflösungen bringt oft selbst High-End-GPUs an ihre Grenzen. Dieser Leitfaden befasst sich mit der Optimierung von ComfyUI-Workflows für anspruchsvolle Aufgaben wie Text-zu-Bild, Bild-zu-Bild und Hochskalierung und behandelt Installation, fortgeschrittene Techniken und Tipps zur Fehlerbehebung. Dies ist keine Anfängeranleitung; wir gehen davon aus, dass Sie bereits mit den Grundlagen von ComfyUI und Stable Diffusion vertraut sind.

Was ist ComfyUI?

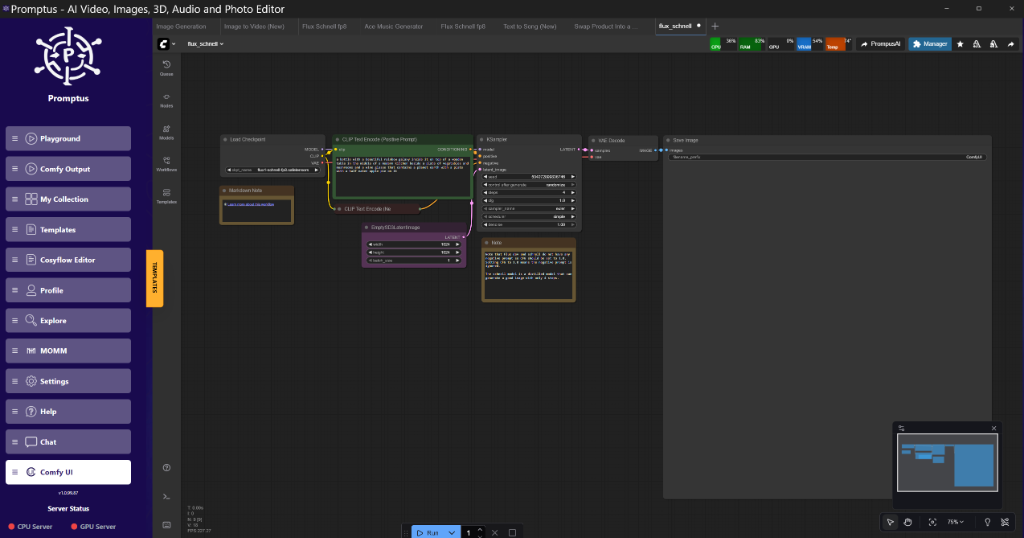

ComfyUI ist eine graphbasierte Benutzeroberfläche für Stable Diffusion. Es bietet eine modulare und flexible Umgebung für die Erstellung komplexer Bilderzeugungs-Workflows. Im Gegensatz zu einfacheren Oberflächen ermöglicht ComfyUI eine detaillierte Kontrolle über jeden Schritt des Prozesses, vom Laden von Modellen bis zum Anwenden benutzerdefinierter Knoten und Skripte.

ComfyUI bietet eine unübertroffene Kontrolle über die Bildgenerierungs-Pipeline. Das knotenbasierte System ermöglicht es Ihnen, jeden Schritt zu visualisieren und zu modifizieren, was es ideal für Experimente und fortgeschrittene Workflows macht. Diese Flexibilität hat jedoch eine steilere Lernkurve im Vergleich zu einfacheren Oberflächen.

!Abbildung: ComfyUI-Schnittstelle mit Beispiel-Workflow bei 0:00

Abbildung: ComfyUI-Schnittstelle mit Beispiel-Workflow bei 0:00 (Quelle: Video)*

Installation

Der erste Schritt ist die Inbetriebnahme von ComfyUI. Die Installation ist unkompliziert, erfordert aber Git und Python. Das ComfyUI-GitHub-Repository (ComfyUI Official) bietet detaillierte Anweisungen für verschiedene Betriebssysteme [1:48].

Goldene Regel: Stellen Sie immer sicher, dass Sie die neuesten Treiber für Ihre GPU haben. Veraltete Treiber können Leistungsprobleme und Fehler verursachen.

Nach der Installation müssen Sie die erforderlichen Modelle herunterladen.

Herunterladen von Modellen

Das Herunterladen von Modellen ist für die Erstellung von Bildern in ComfyUI unerlässlich. Modelle werden von Seiten wie Civitai und Hugging Face heruntergeladen. Diese Modelle werden dann in den richtigen Ordner innerhalb von ComfyUI gelegt, um innerhalb des Knotendiagramms darauf zugreifen zu können.

ComfyUI wird nicht mit vorinstallierten Modellen geliefert. Sie müssen diese separat von Quellen wie Civitai und Hugging Face herunterladen [4:00]. Platzieren Sie die heruntergeladenen Modelldateien (typischerweise .ckpt oder .safetensors) im Verzeichnis ComfyUI/models/checkpoints. In ähnlicher Weise kommen VAE-Dateien in ComfyUI/models/vae und LoRA-Modelle in ComfyUI/models/loras.

Text zu Bild

Text-zu-Bild ist ein grundlegender Workflow in ComfyUI. Es beinhaltet das Verbinden von Knoten zum Laden eines Checkpoints, zum Eingeben einer Eingabeaufforderung, zum Sampling, zum Dekodieren des Bildes und zum Speichern der Ausgabe. Durch Anpassen der Parameter jedes Knotens können Sie den Generierungsprozess steuern.

Der grundlegende Text-zu-Bild-Workflow umfasst mehrere Schlüsselknoten [7:25]:

- Checkpoint laden: Lädt das Stable Diffusion-Modell.

- CLIP-Textcodierung (Prompt): Codiert die positiven und negativen Prompts.

- Leeres latentes Bild: Erstellt einen leeren latenten Raum für das Bild.

- KSampler: Führt den Sampling-Prozess durch und generiert das latente Bild.

- VAE-Dekodierung: Dekodiert das latente Bild in ein Pixelbild.

- Bild speichern: Speichert das generierte Bild.

Verbinden Sie diese Knoten in der richtigen Reihenfolge und passen Sie Parameter wie Sampler, Scheduler und CFG-Skala im KSampler-Knoten an. Experimentieren Sie mit verschiedenen Prompts und Modell-Checkpoints, um zu sehen, wie sie sich auf die Ausgabe auswirken.

!Abbildung: Grundlegendes Text-zu-Bild-Workflow-Knotendiagramm bei 10:00

Abbildung: Grundlegendes Text-zu-Bild-Workflow-Knotendiagramm bei 10:00 (Quelle: Video)*

Navigation, Bearbeitung und Kurzbefehle

Die Navigation und Bearbeitung von Workflows in ComfyUI wird durch die Verwendung von Kurzbefehlen vereinfacht. Diese Kurzbefehle erhöhen die Geschwindigkeit der Workflow-Entwicklung und die Effizienz.

ComfyUI bietet mehrere Tastenkombinationen, um die Workflow-Erstellung zu optimieren [21:30]:

Strg+C, Strg+V: Knoten kopieren und einfügen.

Strg+Umschalt+K: Prompt in die Warteschlange stellen.

Strg+B: Einen Knoten umgehen.

Doppelklick: Knoteneigenschaften öffnen.

Drag & Drop: Knoten verbinden.

Machen Sie sich mit diesen Kurzbefehlen vertraut, um Ihre Workflow-Effizienz zu verbessern.

Installation von ComfyUI Manager & Git

Die Installation von ComfyUI Manager und Git ist für die Verwaltung von Plugins und Abhängigkeiten erforderlich. Der ComfyUI Manager vereinfacht den Prozess der Installation, Aktualisierung und Entfernung von benutzerdefinierten Knoten und Erweiterungen. Git ist erforderlich, um den Manager selbst herunterzuladen und zu verwalten.

Der ComfyUI Manager vereinfacht die Installation und Verwaltung von benutzerdefinierten Knoten und Erweiterungen [26:15]. Um ihn zu installieren, benötigen Sie Git. Laden Sie Git von der offiziellen Website herunter und befolgen Sie die Installationsanweisungen. Klonen Sie dann das ComfyUI Manager-Repository in das Verzeichnis ComfyUI/custom_nodes.

Hochskalierung

Hochskalierung ist der Prozess der Erhöhung der Auflösung eines Bildes. In ComfyUI können Sie Bilder mit verschiedenen Techniken und Modellen hochskalieren. Die gekachelte Hochskalierung ist eine häufig verwendete Technik, um die VRAM-Nutzung zu reduzieren, wenn auf extreme Auflösungen hochskaliert wird.

Die Hochskalierung ist entscheidend, um die Auflösung und Detailgenauigkeit generierter Bilder zu verbessern [28:43]. ComfyUI bietet verschiedene Hochskalierungsmethoden, darunter:

Latente Hochskalierung: Skaliert das latente Bild vor der Dekodierung hoch.

Bild-Hochskalierung: Skaliert das dekodierte Bild hoch.

Kachel-Hochskalierung: Teilt das Bild in Kacheln auf, skaliert jede Kachel separat hoch und fügt sie dann wieder zusammen. Dies reduziert die VRAM-Nutzung.

Für die Hochskalierung mit hoher Auflösung wird im Allgemeinen die Kachel-Hochskalierung bevorzugt.

Bild zu Bild

Bild-zu-Bild ist ein Workflow, der ein vorhandenes Bild als Basis für die Generierung eines neuen Bildes verwendet. Es beinhaltet das Codieren des Eingangsbildes in den latenten Raum, das Hinzufügen von Rauschen und das anschließende Steuern des Entrauschungsprozesses mit einem Prompt.

Mit Bild-zu-Bild können Sie vorhandene Bilder mithilfe von Stable Diffusion transformieren [37:49]. Der grundlegende Workflow umfasst:

- Bild laden: Lädt das Eingangsbild.

- VAE-Codierung: Codiert das Bild in den latenten Raum.

- Rauschen hinzufügen: Fügt dem latenten Bild Rauschen hinzu.

- KSampler: Führt den Sampling-Prozess durch, der von einem Prompt gesteuert wird.

- VAE-Dekodierung: Dekodiert das latente Bild in ein Pixelbild.

- Bild speichern: Speichert das generierte Bild.

Passen Sie die Menge des hinzugefügten Rauschens an, um den Grad der Transformation zu steuern.

Kachel-Hochskalierung

Die gekachelte Hochskalierung ist eine Technik zum Hochskalieren